IA Act : Conformité 2026 pour les entreprises

La régulation n'est pas un frein, c'est un filtre de qualité. Avec l'application complète de l'IA Act en Europe, les entreprises doivent désormais naviguer entre innovation technologique et conformité stricte. Pour les dirigeants, la question n'est plus pouvons-nous utiliser l'IA ?, mais comment l'utiliser sans exposer juridiquement l'entreprise ?

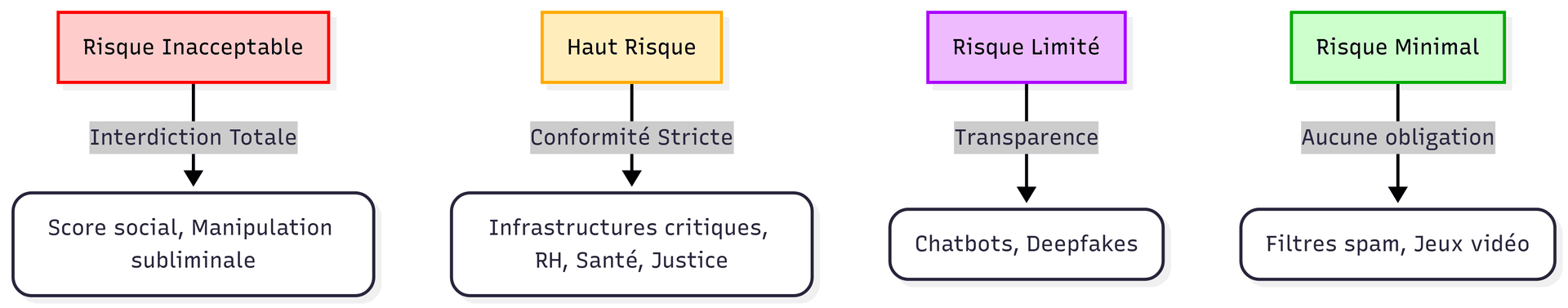

Comprendre la pyramide des risques

L'IA Act classe les systèmes d'intelligence artificielle en quatre catégories. La majorité des outils utilisés en entreprise (RH, scoring crédit, infrastructures critiques) tombent dans la catégorie Haut Risque. Cela implique des obligations lourdes : traçabilité des données, supervision humaine et documentation technique rigoureuse.

SCHÉMA : PYRAMIDE DES RISQUES IA ACT

Représentation des niveaux de risque selon l'UE

Le piège des solutions Boîte Noire

L'utilisation de modèles publics (comme ChatGPT via API standard) pose un problème majeur de souveraineté des données. Dès lors qu'une donnée sensible quitte vos serveurs pour être traitée aux États-Unis, vous vous exposez à une non-conformité non seulement avec l'IA Act, mais aussi avec le RGPD.

C'est ici qu'intervient l'approche SecNumCloud. Chez Evolia Stratégie, nous privilégions le déploiement de modèles Open Source (comme Mistral ou Llama) hébergés sur des infrastructures privées souveraines.

La Check-list du décideur pour 2026

- Cartographie : Avez-vous listé tous les systèmes d'IA utilisés (même le Shadow AI) ?

- Qualification : Vos cas d'usage relèvent-ils de la catégorie Haut Risque ?

- Gouvernance : Qui est responsable de l'éthique et de la validation des outputs de l'IA ?

- Sécurité : Vos données d'entraînement sont-elles protégées contre le Model Poisoning ? Pour en savoir plus, consultez notre page sur la sécurité des données.

Besoin d'un audit de conformité ?

Ne laissez pas le risque juridique paralyser votre innovation.

Contacter nos experts en régulation IA