Sécurité des données IA : Guide Private LLM

Le dilemme du CISO moderne est brutal. D'un côté, la pression opérationnelle pour intégrer l'IA générative est immense : gain de productivité, analyse documentaire massive, assistants bancaires intelligents. De l'autre, la nature même des modèles de langage (LLM) publics représente un cauchemar de cybersécurité : exfiltration de données, model poisoning et non-conformité réglementaire.

Pour les secteurs critiques comme la Banque, l'Assurance et la Défense, l'approche standard (envoyer des prompts vers une API américaine) est simplement inenvisageable. Cet article détaille l'architecture technique exacte pour bénéficier de la puissance des LLM sans jamais compromettre la souveraineté de vos données.

Le Risque Boîte Noire

Lorsque vous utilisez un modèle public, vos données d'entrée (prompts) peuvent être utilisées pour ré-entraîner le modèle global. Imaginez un ingénieur Samsung collant du code source confidentiel pour le déboguer : ce code devient partie intégrante de la connaissance du modèle public.

La Réponse Evolia

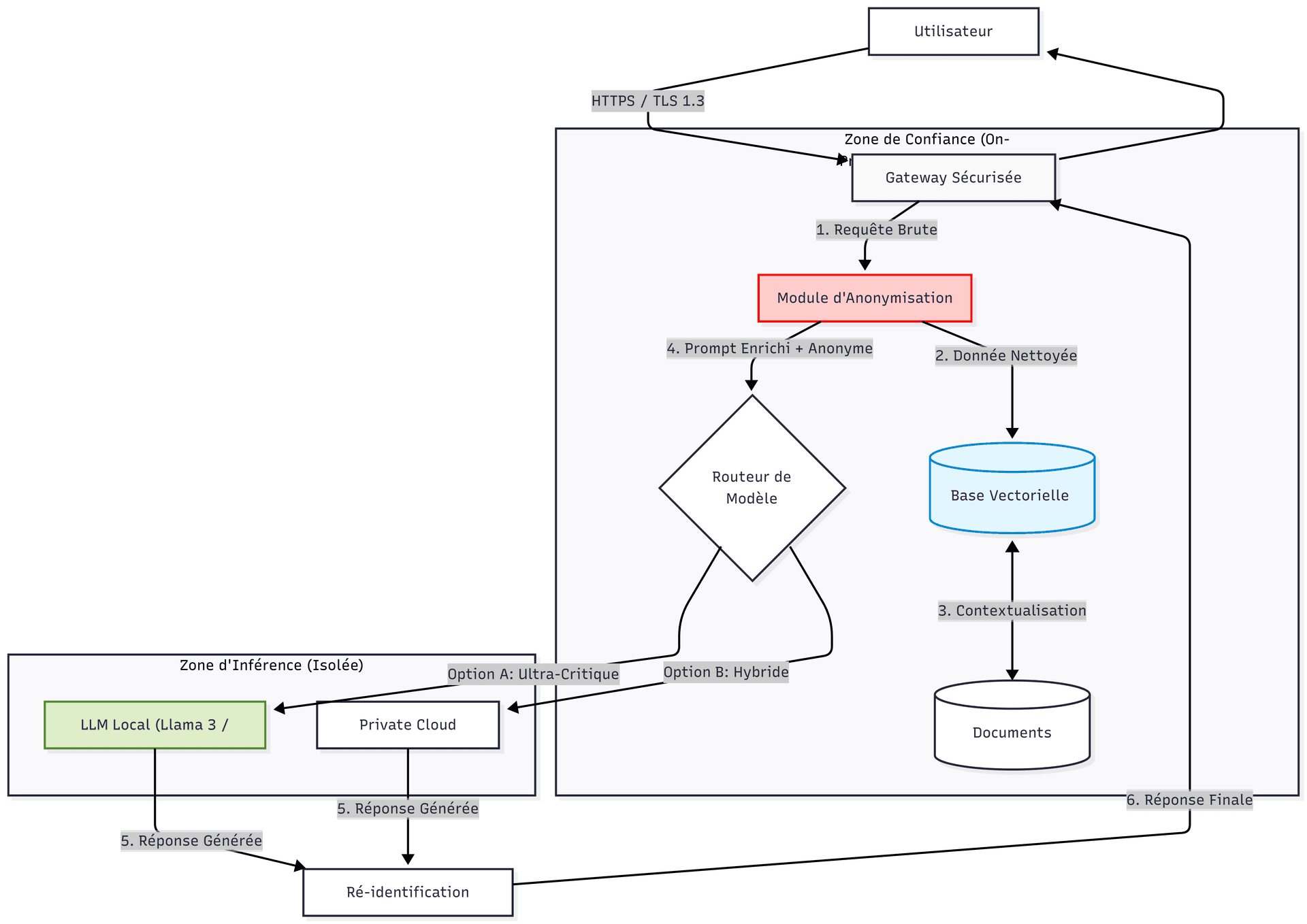

L'isolation totale. Nous construisons des environnements où le modèle vient à la donnée, et non l'inverse. C'est le principe du Private LLM Hosting.

1. Architecture : On-Premise vs Cloud Hybride Sécurisé

Il n'existe pas de solution unique, mais un spectre de souveraineté. Selon la sensibilité de la donnée (par exemple, Diffusion Restreinte ou Secret Défense vs Données Clients), nous déployons deux types d'architectures distinctes détaillées sur notre page Architecture & Sécurité.

L'approche Air-Gapped (On-Premise Total)

C'est le standard pour les OIV (Opérateurs d'Importance Vitale). Ici, le modèle LLM (souvent un modèle Open Weights comme Mistral ou Llama 3) est téléchargé et conteneurisé. Il tourne sur vos propres serveurs GPU (Nvidia H100/A100).

- Avantage : Aucune donnée ne quitte votre réseau physique. Risque d'interception nul.

- Inconvénient : Coût d'infrastructure (CAPEX) élevé et maintenance des modèles complexe (ModelOps).

L'approche VPC (Virtual Private Cloud)

Pour les acteurs de la Finance, cette approche offre le meilleur équilibre. Nous utilisons des instances dédiées chez des hébergeurs certifiés SecNumCloud (comme OVHcloud ou NumSpot). Le modèle est isolé dans un tenant privé.

2. Le Data Sanitation Layer : Anonymisation avant inférence

Même dans un environnement privé, le principe de précaution (et le RGPD) impose de minimiser l'exposition des données personnelles (PII). C'est pourquoi nous plaçons systématiquement une couche de Sanitation entre l'utilisateur et le modèle.

Reconnaissance d'Entités Nommées (NER)

Avant que le prompt ne quitte l'interface utilisateur, un algorithme léger (type BERT) scanne le texte pour identifier : Noms, IBAN, Numéros de Sécurité Sociale, Adresses IP.

Tokenisation & Pseudonymisation

Ces entités sont remplacées par des tokens génériques (ex: [CLIENT_ID_123]). Une table de correspondance éphémère est conservée en mémoire vive (RAM) uniquement le temps de la session.

Ré-identification en post-traitement

Une fois que le LLM a généré sa réponse (en utilisant les tokens), la gateway inverse le processus pour réafficher les vrais noms à l'utilisateur autorisé. Le LLM n'a jamais vu le nom du client.

3. Cas d'usage : Secteur Bancaire & Conformité

Dans le secteur bancaire, la conformité est reine. L'utilisation de l'IA pour l'analyse de risque de crédit ou la détection de fraude nécessite une traçabilité totale. C'est ce qu'on appelle l'Explicabilité (XAI).

Contrairement aux modèles boîte noire, nos architectures permettent de sourcer chaque affirmation. En utilisant une architecture RAG (Retrieval Augmented Generation), le modèle doit citer le document interne (PDF, Excel) qui a servi à générer la réponse. Pour en savoir plus sur les applications financières, consultez notre page dédiée au secteur Finance.

L'importance de l'Audit des Logs

Une architecture sécurisée doit inclure un système de logging avancé qui enregistre :

- Qui a posé la question ?

- Quelle version du modèle a été utilisée ?

- Quel score de toxicité ou de confiance a été attribué à la réponse ?

Ces logs ne doivent jamais contenir les données déchiffrées des prompts, mais uniquement les métadonnées techniques pour l'audit de sécurité.

4. Conclusion : La souveraineté est un choix technique

Sécuriser un projet d'IA générative demande une expertise qui va bien au-delà de la data science. Cela nécessite des compétences pointues en infrastructure, en cryptographie et en conformité légale (IA Act, RGPD).

Chez Evolia Stratégie, nous ne nous contentons pas d'intégrer des API. Nous bâtissons des forteresses numériques pour vos intelligences artificielles.

Votre architecture est-elle vulnérable ?

Nous proposons un audit de sécurité spécifique aux projets GenAI pour identifier les fuites potentielles de données avant qu'elles ne se produisent.